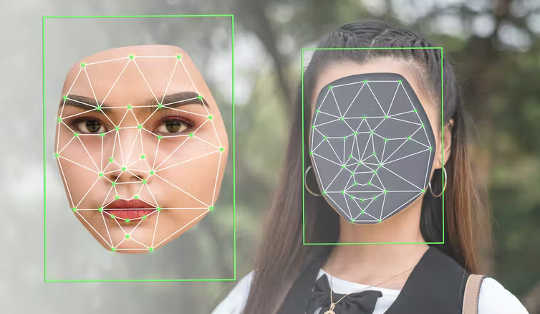

Η τεχνολογία που μπορεί να παράγει deepfakes είναι ευρέως διαθέσιμη. (Shutterstock)

Στις αρχές Μαρτίου, α Κυκλοφόρησε παραποιημένο βίντεο του Ουκρανού προέδρου Βολοντίμιρ Ζελένσκι. Σε αυτό, ένας ψηφιακά δημιουργημένος Zelenskyy είπε στον ουκρανικό εθνικό στρατό να παραδοθεί. Το βίντεο κυκλοφόρησε στο Διαδίκτυο, αλλά γρήγορα απομυθοποιήθηκε ως deepfake - ένα υπερρεαλιστικό αλλά ψεύτικο και παραποιημένο βίντεο που δημιουργήθηκε με χρήση τεχνητής νοημοσύνης.

Ενώ η ρωσική παραπληροφόρηση φαίνεται να έχει περιορισμένο αντίκτυπο, αυτό το ανησυχητικό παράδειγμα επεξηγεί τις πιθανές συνέπειες των deepfakes.

Ωστόσο, τα deepfakes χρησιμοποιούνται με επιτυχία στην υποστηρικτική τεχνολογία. Για παράδειγμα, άτομα που πάσχουν από τη νόσο του Πάρκινσον μπορούν να χρησιμοποιήσουν κλωνοποίηση φωνής για να επικοινωνήσουν.

Τα Deepfakes χρησιμοποιούνται στην εκπαίδευση: η εταιρεία σύνθεσης ομιλίας με έδρα την Ιρλανδία CereProc δημιούργησε μια συνθετική φωνή για τον John F. Kennedy, επαναφέροντάς τον στη ζωή για να εκφωνήσει τον ιστορικό του λόγο.

Ωστόσο, κάθε νόμισμα έχει δύο όψεις. Τα Deepfakes μπορεί να είναι υπερρεαλιστικά και βασικά μη ανιχνεύσιμο από τα ανθρώπινα μάτια.

Επομένως, η ίδια τεχνολογία κλωνοποίησης φωνής θα μπορούσε να χρησιμοποιηθεί για phishing, δυσφήμιση και εκβιασμό. Όταν τα deepfakes χρησιμοποιούνται σκόπιμα για την αναμόρφωση της κοινής γνώμης, την υποκίνηση κοινωνικών συγκρούσεων και τη χειραγώγηση των εκλογών, έχουν τη δυνατότητα να υπονομεύσουν τη δημοκρατία.

Ερευνητές στο Πανεπιστήμιο της Ουάσιγκτον δημιούργησαν ένα deepfake του Μπαράκ Ομπάμα.

Προκαλώντας χάος

Τα Deepfakes βασίζονται στην τεχνολογία που είναι γνωστή ως γενετικά δίκτυα αντιπάλων στην οποία δύο αλγόριθμοι εκπαιδεύουν ο ένας τον άλλον για την παραγωγή εικόνων.

Ενώ η τεχνολογία πίσω από τα βαθιά ψεύτικα μπορεί να ακούγεται περίπλοκη, είναι απλή υπόθεση να παραχθεί. Υπάρχουν πολλές διαδικτυακές εφαρμογές όπως π.χ Απορρόφηση προσώπου και ZAO Deepswap που μπορεί να δημιουργήσει deepfakes μέσα σε λίγα λεπτά.

Το Google Colaboratory — ένας διαδικτυακός χώρος αποθήκευσης κώδικα σε πολλές γλώσσες προγραμματισμού — περιλαμβάνει παραδείγματα κώδικα που μπορεί να χρησιμοποιηθεί για τη δημιουργία ψεύτικων εικόνων και βίντεο. Με αυτό το προσβάσιμο λογισμικό, είναι εύκολο να δείτε πώς οι μέσοι χρήστες θα μπορούσαν να προκαλέσουν τον όλεθρο με deepfakes χωρίς να συνειδητοποιήσουν τους πιθανούς κινδύνους ασφαλείας.

Η δημοτικότητα των εφαρμογών ανταλλαγής προσώπων και των διαδικτυακών υπηρεσιών όπως Βαθιά νοσταλγία δείχνουν πόσο γρήγορα και ευρέως τα deepfakes θα μπορούσαν να υιοθετηθούν από το ευρύ κοινό. Το 2019, Εντοπίστηκαν περίπου 15,000 βίντεο που χρησιμοποιούν deepfakes. Και ο αριθμός αυτός αναμένεται να αυξηθεί.

Τα Deepfakes είναι το τέλειο εργαλείο για καμπάνιες παραπληροφόρησης επειδή παράγουν πιστευτές ψευδείς ειδήσεις που χρειάζονται χρόνο για να απομυθοποιηθούν. Εν τω μεταξύ, οι ζημιές που προκαλούνται από τα deepfakes — ειδικά εκείνα που επηρεάζουν τη φήμη των ανθρώπων — είναι συχνά μακροχρόνιες και μη αναστρέψιμες.

Το DeepSwap είναι μια εξαιρετική επιλογή για όποιον θέλει να δημιουργήσει πειστικά deepfakes με ελάχιστη προσπάθεια. ??t;a href="https://twitter.com/hashtag/DeepSwap?src=hash&ref_src=twsrc%5Etfw">#DeepSwap #FaceSwap #DeepFake #FaceApp #Ανακαινίζω #Ανασκόπηση #Κριτικές #Τεχνητή νοημοσύνη #ΟΛΑ ΣΥΜΠΕΡΙΛΑΜΒΑΝΟΝΤΑΙ #Tech #Τεχνολογία #TechNews #TechnologyNews #ΜΕΝΑ #TechMGZNhttps://t.co/A2Cbp02sH1

— Tech Magazine (@TechMGZN) 4 Μαΐου 2022

Το να βλέπεις πιστεύεις;

Ίσως η πιο επικίνδυνη διακλάδωση των deepfakes είναι ο τρόπος με τον οποίο προσφέρονται για παραπληροφόρηση σε πολιτικές εκστρατείες.

Το είδαμε αυτό όταν ο Ντόναλντ Τραμπ χαρακτήρισε οποιαδήποτε μη κολακευτική κάλυψη από τα μέσα ενημέρωσης ως «ψεύτικο ειδήσεις.» Κατηγορώντας τους επικριτές του ότι διακινούν ψεύτικες ειδήσεις, ο Τραμπ μπόρεσε να χρησιμοποιήσει την παραπληροφόρηση για να υπερασπιστεί τα λάθη του και ως εργαλείο προπαγάνδας.

Η στρατηγική του Τραμπ του επιτρέπει να διατηρεί την υποστήριξη σε ένα περιβάλλον γεμάτο δυσπιστία και παραπληροφόρηση υποστηρίζοντας «ότι αληθινά γεγονότα και ιστορίες είναι fake news ή deepfakes. "

Η αξιοπιστία στις αρχές και τα μέσα ενημέρωσης υπονομεύεταιδημιουργώντας κλίμα δυσπιστίας. Και με τον αυξανόμενο πολλαπλασιασμό των deepfakes, οι πολιτικοί θα μπορούσαν εύκολα να αρνηθούν την ευθύνη σε τυχόν αναδυόμενα σκάνδαλα. Πώς μπορεί να επιβεβαιωθεί η ταυτότητα κάποιου σε ένα βίντεο εάν το αρνηθεί;

Η καταπολέμηση της παραπληροφόρησης, ωστόσο, ήταν πάντα μια πρόκληση για τις δημοκρατίες, καθώς προσπαθούν να υποστηρίξουν την ελευθερία του λόγου. Οι συνεργασίες ανθρώπου-τεχνητής νοημοσύνης μπορούν να βοηθήσουν στην αντιμετώπιση του αυξανόμενου κινδύνου των deepfakes, ζητώντας από τους ανθρώπους να επαληθεύουν τις πληροφορίες. Θα μπορούσε επίσης να εξεταστεί το ενδεχόμενο εισαγωγής νέας νομοθεσίας ή εφαρμογής υφιστάμενων νόμων για την τιμωρία των παραγωγών deepfakes για παραποίηση πληροφοριών και πλαστοπροσωπία ατόμων.

Οι διεπιστημονικές προσεγγίσεις από διεθνείς και εθνικές κυβερνήσεις, ιδιωτικές εταιρείες και άλλους οργανισμούς είναι όλες ζωτικής σημασίας για την προστασία των δημοκρατικών κοινωνιών από ψευδείς πληροφορίες.

Σχετικά με το Συγγραφέας

Sze-Fung Lee, Ερευνητής, Τμήμα Πληροφοριακών Σπουδών, Πανεπιστήμιο McGill και Benjamin CM Fung, Καθηγητής και Ερευνητική Έδρα Καναδά στην Εξόρυξη Δεδομένων για την Κυβερνοασφάλεια, Πανεπιστήμιο McGill

Αυτό το άρθρο αναδημοσιεύθηκε από το Η Συνομιλία υπό την άδεια Creative Commons. Διαβάστε το αρχικό άρθρο.